How To Safely Unlock AI for The Business By Taking a Data-Led Approach

AI adoption is becoming essential. It’s transforming how we work, how we innovate, and—let’s be real—how we write email faster. Every one of you is probably wondering if I used AI to write this blog.

It’s abundantly clear that AI tools like ChatGPT, Copilot, DeepSeek and others are driving efficiency for employees. In doing so, they’re also creating an incredible opportunity for CISO, CDOs and Infrastructure leaders to lean in, and win the hearts and minds of the boardroom by saying yes to AI. This means understanding how to overcome barriers to quickly, and widely adopting AI.

I talk to senior IT leaders and industry analysts every week, and the same concerns keep bubbling up:

- What sensitive data do we have?

- Where is our most sensitive data?

- What AI tools are active within my organization?

- Which AI tools have access to it?

- How do we make sure AI tools don’t expose data they shouldn’t?

- What if employees unknowingly share confidential info with AI tools?

And I get it. The traditional security playbook that included secure web gateways, DLP, endpoint security, identity security and SIEM - just doesn’t cut it anymore. They lacked one of the most vital pieces of effective security. Data insights. Even modern solutions like cloud security posture management can’t address the real issue here. Navigating data security in the age of AI.

At Cyera, we’re helping businesses safely adopt AI without placing their sensitive data at unnecessary levels of risk. These four steps below outline how. I’ve also added how the Cyera AI-Native Data Security Platform helps.

Step 1: Discover Sensitive Data and AI Tools

Your Goal: Know your data, and your AI tools

The first rule of securing AI? You can’t protect what you don’t know exists. Most companies have no clue where their sensitive data is stored, let alone which AI tools employees are using. Ghost data, and Ghost AI does exist —and if you’re not looking for it, you won’t find it.

Cyera allows customers to:

- Automatically discover and classify sensitive data across cloud environments

- Identify which AI tools are in use (even the ones security teams aren’t aware of)

Basically, we help you by creating an inventory of what needs to be protected. Cyera DSPM discovers the data, and provides rich data context like identifiability, residency, type, role and overall security posture. Cyera Identity discovers the entities, and provides vital context about it like internal vs. external, stale identity, ghost identity etc.

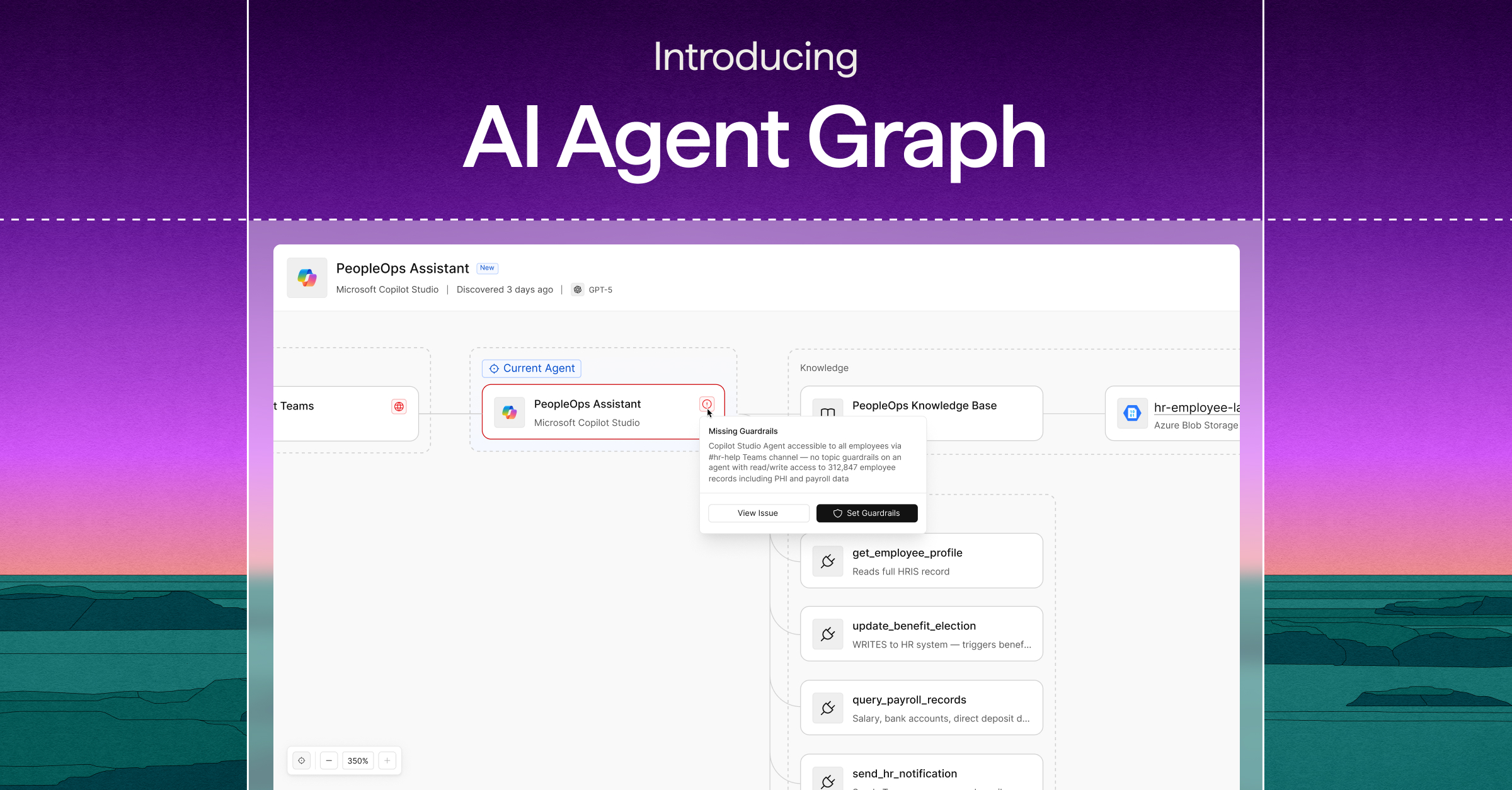

Step 2: Improve Access Governance for AI Tools

Your Goal: Set Guardrails for AI Access

AI tools don’t always play by traditional data security rules. They can access and process massive amounts of sensitive data, often with no, or very little, regard for authorization. If an AI tool accidentally ingests customer PII or financial data, you’ve got a compliance nightmare on your hands.

Cyera’s value here:

- Show which AI tools can access sensitive data

- Right-size access by enforcing policies that keep AI in check

With Cyera DSPM and Cyera Identity, you can limit AI access to only the data it actually needs—so you get the benefits without the security risks. We refer to this internally as putting AI on a need to know basis

Step 3: Monitor Misuse of GenAI & Improve Awareness

Your Goal: Stop AI Misuse Before It Becomes a Headline

Let’s be honest—most AI security issues come from people making mistakes. In most cases, not all, but most, employees don’t intend to share sensitive data with AI tools, but without the right safeguards, it does happen. And bad actors? They’re actively looking for ways to exploit AI, and the immature data security policies around it, to extract sensitive info.

How Cyera Helps:

- Detect and prevent inappropriate AI access to sensitive data

- Monitor AI interactions and educate employees on AI security best practices

With Cyera DSPM, Cyera Identity, and Cyera DLP, you can spot risky AI behaviors, coach employees in real time, and make sure your data stays where it belongs. Essentially making sure these tools are being used responsibly and ethically.

Step 4: Prevent Data Leakage While Using GenAI Tools

Your Goal: Block Data Leaks Before They Happen

Here’s the worst-case scenario: An employee accidentally uploads proprietary data into an AI tool, and that data gets used to train future models. Now, your confidential information is out in the wild—and there’s no undo button.

How Cyera Helps:

- Stop sensitive data from being shared with unauthorized AI tools (ChatGPT), APIs, or services

- Enforce real-time policies that prevent AI-related data leaks

By combining Cyera DSPM, Cyera Identity, and Cyera DLP, organizations can prevent AI from becoming a data leakage risk—without slowing down innovation. It’s also worth noting that this is especially important when it comes to GenAI, because it can sometimes produce unexpected sensitive content as part of its output.

Take a Data-Led Approach to AI Adoption

AI is here to stay. It’s changing how businesses operate, and those that don’t embrace it will be left behind. But data security can’t be an afterthought. In fact, the more you focus on data security upfront, the faster you can roll out AI across the organization.

Always happy to chat about what we are seeing in the market. Let’s connect.

.svg)