Cas d'utilisation

Cyera pour une utilisation sûre et sécurisée de l'IA

Favorisez l'adoption de l'IA tout en gardant vos données sécurisées. Découvrez, isolez et assainissez les données sensibles afin de garantir qu'elles ne soient accessibles qu'aux Copilotes IA et grands modèles de langage (LLM) autorisés.

L'adoption de l'IA est transformative.

Cyera rend cela plus sûr

L'IA offre un potentiel immense, mais elle présente également de nouveaux risques en matière de sécurité des données, de confidentialité et de conformité. Les organisations doivent s'assurer que les données sensibles sont protégées et que les systèmes d'IA ne divulguent, n'ingèrent ou n'utilisent pas involontairement des informations. Avec Cyera, vous bénéficiez d'une meilleure visibilité sur les données utilisées pour les initiatives d'IA.

80 %

des entreprises explorent ou mettent en œuvre des solutions d'IA

55 %

des entreprises ont cité la confidentialité des données et la sécurité comme principaux défis de la mise en œuvre de l'IA

15,7 B$US

ajout attendu de l'IA à l'économie mondiale d'ici 2030

Rechercher et classer les données pour l'utilisation de l'IA

Accélérez la préparation à l’IA grâce à une découverte rapide des données, en identifiant les données sensibles avant qu’elles n’entrent dans les modèles ou outils d’IA.

Classifiez automatiquement les types de données pour une utilisation sécurisée de l'IA, comme les informations personnelles, les dossiers financiers ou la propriété intellectuelle.

Obtenez des informations sur la résidence des données, la conservation et les mesures de protection afin d'éviter toute exposition involontaire ou problème de conformité lors de l'utilisation de l'IA.

Attribuez les étiquettes de confidentialité appropriées pour garantir que les outils d’IA comme Microsoft Copilot utilisent les bonnes données.

Évaluer les risques liés aux données de l'IA

Comprenez les risques potentiels liés à l'utilisation des données de l'entreprise dans des projets d'IA critiques.

Identifiez les données à haut risque qui ne doivent pas être utilisées dans les modèles et outils d'IA afin de réduire votre risque

Évaluez l'exposition au risque provenant d'acteurs non humains en identifiant les outils d'IA ayant accès à des données sensibles.

Détectez les potentielles violations de conformité, les accès trop permissifs ou non autorisés, introduits par l'utilisation de données sensibles dans les systèmes d'IA, tels que les LLM ou les copilotes.

Surveiller en continu les problèmes de données d'IA

Gardez le contrôle de vos données en évaluant en continu les risques et en suivant les changements liés aux données utilisées par les systèmes d'IA.

Protégez-vous contre les menaces internes en identifiant les identités et en attribuant des niveaux de confiance selon le contexte, comme : MFA activée ou désactivée, utilisateur interne ou externe, activité inhabituelle, et plus encore.

Surveillez la conformité des données et les risques liés à l'IA grâce à des politiques prédéfinies qui signalent automatiquement les problèmes critiques.

Détectez et corrigez les étiquettes de confidentialité Microsoft mal alignées pour empêcher que des données ne soient transmises à Microsoft Copilot ou à des modèles d'IA.

Témoignage client

Comment ACV Auctions utilise Cyera pour contrôler l'exposition des données sensibles dans le cloud

Get Data Risk Assessment

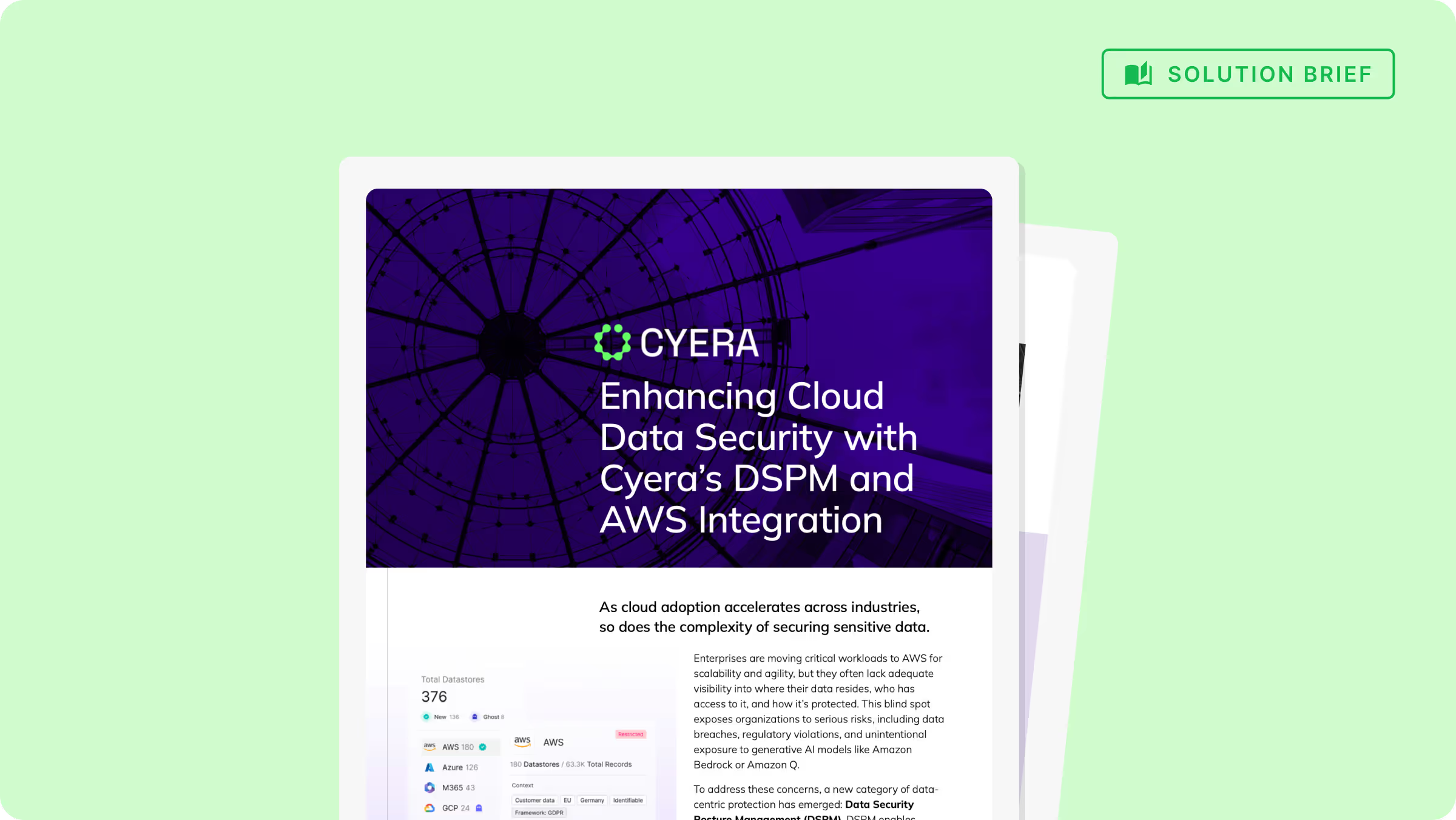

Cyera makes it easy for security teams to procure and connect our solution to their cloud solution provider platform. Marketplace integrations make it easy to get started.

.avif)